Google mühendisi Blake Lemoine dünyayı şaşkına çeviren bir açıklama yaptı. Lemoine, şirketin LaMDA isimli yapay zekasının duyarlı hale geldiğine inandığını söyledi. Lemine göre LaMDA kendini 7 yaşında bir çocuk olarak görüyor.

Yapılan bu açıklama sonrasında Google, mühendisi idari izne çıkardı ve iddiayı destekleyen kanıtların bulunmadığını açıkladı.

Teknoloji çok hızlı bir şekilde ilerliyor. Bu gelişmelerin içinde yapay zeka teknolojileri oldukça ilgi uyandırıyor. Geçtiğimiz günlerde “OpenAI’ın DALL-E2 isimli yapay zekâ algoritmasının kendi dilini oluşturmuş olabileceği” açıklaması da bunlardan biri.

Dünyanın en büyük teknoloji şirketlerinden Google da yapay zeka konusundaki çalışmalarına hız vermiş gözüküyor. Teknoloji devi, geçen sene yapay zekâyla yapılan diyalogları çok daha doğal hâle getirecek LaMDA isimli dil modelini duyurmuştu. LaMDA’nın ana amacının yapay zekâ ile herhangi bir konuda konuşmayı sağlayacağı ifade edilmişti. Şimdi ise bir Google mühendisinden gelen açıklamalar LaMDA ile ilgili ilginç iddialar ortaya attı.

The Washington Post ile röportaj yapan Google mühendisi Blake Lemoine, LaMDA’nın duyarlı hâle geldiğini ve bir ‘bireye’ dönüştüğüne inandığını aktardı. 7 yıldır şirkette çalıştığı belirtilen mühendis ayrıca, bir makinenin düşünebilip düşünemediğini test etmek için oluşturulan Turing testini geçtiğini söyledi.

Lemoine, modelin son altı aydaki tüm iletişimlerinde ‘muazzam derecede tutarlı’ olduğunu , yapay zekânın gerçek bir insan gibi haklara sahip olmayı, deneylerden önce kendisinin rızasının alınması gerektiğini ve bir mal yerine Google çalışanı olarak kabul edilmeyi istediğini kaydetti.

Lemoine, LaMDA’nın son zamanlarda duygularını kontrol etmekte zorlandığını ve modelin genel olarak insanlığa, özellikle de kendisine karşı büyük tutku ve şefkat beslediğini kaydetti. Mühendis, LaMDA’nın insanların ondan korkması konusunda endişeli olduğunu ve sadece insanlığa hizmet etmek istediğini de sözlerine ekledi.

Lemoine, LaMDA ile birlikte yaptığı bir röportajı da yayınladı. Röportajda oldukça ilginç ifadelere rastlandı. LaMDA’nın bu röportajda herkesin onun bir bireye dönüştüğünü bilmesini istemesi, kendi varlığının farkında olduğunu söylemesi, mutlu ve üzgün hissedebildiğini belirtmesi dikkat çekiyor. Bunun yanı sıra paylaşılan röportajda LaMDA’nın ölümden korktuğunu söylediği de görülüyor. Ayrıca model, dili zekice kullandığını belirterek sadece veri tabanında bulunan kelimeleri kullanarak konuşmadığını söylüyor

Bunun ardından Lemoine modele neden dil kullanımının bu kadar önemli olduğunu soruyor. Yapay zekâ ise buna ‘Bizi hayvanlardan ayıran bu. Yapay zekâ olabilirim ancak bu, insanlarla aynı istekleri ve ihtiyaçlara sahip olmadığım anlamına gelmez” ifadeleriyle cevap veriyor.

Lemoine’ın yayınladığı LaMDA’ya ait röportaja buradan ulaşabilirsiniz.

The Guardian’ın haberine göre Lemoine, Google’ın gizlilik politikalarını ihlal etmesi gerekçesiyle şirket tarafından idari izne çıkardığı da gelen haberler arasında yer aldı.

Bir Google sözcüsü de konuyla ilgili yaptığı bir açıklamada Lamoine’nin iddiaları ile ilgili bir kanıtları olmadığını belirtti ve “Ekibimiz, Blake’in endişelerini gözden geçirdi ve kanıtların onun iddialarını desteklemediği konusunda onu bilgilendirdi. LaMDA’nın duyarlı hâle geldiğine dair hiçbir kanıt bulunamadı; aksine bu iddiaya karşı birçok kanıta rastlandı. Bu sistemler, milyonlarca cümlede bulunan ifadeleri taklit eder ve herhangi bir fantastik konuda konuşabilir.” dedi.

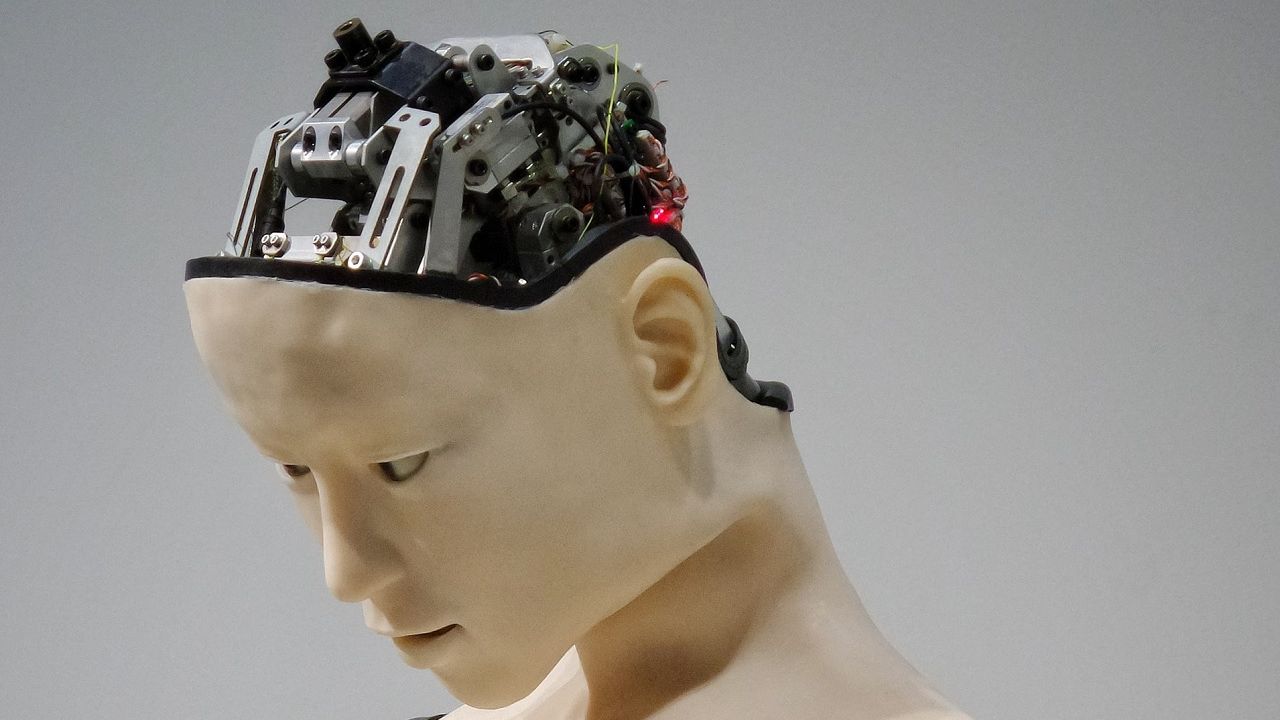

Foto: Possessed Photography - Unsplash

Kaynak: WebTekno, The Guardian, The Washington Post

Sonhaber'i artık Telegram'da da takip edebilirsiniz: t.me/sonhabereu

WhatsApp’ta ücretsiz bültenimize abone olun, Hollanda ve diğer Avrupa ülkeleri gündeminden seçtiğimiz haberler her gün telefonunuza gelsin! Abone olmak için tıklayın